Hvorfor stopper min produktionslinje hele tiden?

De fleste uplanlagte stop skyldes en kort liste af årsager, der forstærker hinanden. Sensorblinde vinkler, forsinket vedligeholdelsesrespons, udstyr der kører ud over de anbefalede driftscyklusser, spændingskvalitetshændelser, råmaterialeafvigelser, PLC-fejl og vagtskiftefejl udgør størstedelen af den tabte produktionstid. At løse dem kræver datakorrelation, ikke flere dashboards.

1. Sensorblinde vinkler

Ca. 23 % af uplanlagte stop [1] kan spores tilbage til sensorer, der ikke målte den rigtige parameter. Vibration på et gearkasseleje, temperatur på en motorvikling, der aldrig blev koblet til PLC'en. Man kan ikke opdage en fejltilstand, man ikke måler på. De fleste fabrikker opdager først disse huller efter en fejlanalyse.

Den typiske linje har mange sensorer, men de blev installeret ud fra OEM'ens standard I/O-liste. Den liste dækker det oplagte: hoveddrevstrøm, hydraulisk tryk, udløbstemperatur. Den dækker sjældent sekundære fejltilstande.

Tag f.eks. en gearkasse på et transportbåndsdrev. OEM'en overvåger olietemperatur og udgangshastighed. Men den hyppigste fejltilstand for den gearkasse er lejeslid på indgangsaksen. Uden en vibrationssensor på det lejehus er det første tegn på problemer et fastlåst leje og en stoppet linje.

Løsningen er ikke at købe flere sensorer i blinde. Gennemgå din nedetids-Pareto. Træk de sidste 12 måneders uplanlagte stop ud. For hvert stop: var der en sensor, der kunne have fanget det 30 minutter tidligere? Hvis ikke, er det en blind vinkel.

Typiske blinde vinkler vi ser igen og igen:

- Motorviklingstemperatur på hjælpedrev (ikke kun hovedspindlen)

- Vibration på gearkassens indgangsleje (ikke kun udgang)

- Trykforskel over filtre, der skiftes efter kalender i stedet for tilstand

- Omgivelsestemperatur nær VFD'er i lukkede tavler

At eftermontere en trådløs vibrationssensor koster 1.500–3.000 kr. pr. målepunkt. Sammenlign det med prisen på ét uplanlagt stop. Regnestykket tager typisk omkring fem sekunder.

2. Forsinket vedligeholdelsesrespons

Den gennemsnitlige tid fra fejlregistrering til værktøj-på-maskine er 47 minutter på fabrikker uden mobile alarmer [2]. Arbejdsordrer ligger i kø. Teknikerne ved ikke, hvilken maskine der udløste alarmen, eller hvilke dele de skal medbringe. Halvdelen af nedetiden er bare logistik, ikke reparation.

En sensor fanger en fejl. PLC'en sender en alarm. Operatøren ringer til vedligehold. Vedligeholdelseskoordinatoren tjekker tavlen, tildeler en tekniker, og teknikeren går til reservedelslageret for dele. Det er i den kæde, at 47 minutter i gennemsnit forsvinder på fabrikker uden mobil udsendelse.

Bryd det ned. Alarm-til-opkald tager 3–5 minutter, fordi operatøren først prøver en genstart. Opkald-til-udsendelse tager 8–15 minutter, fordi koordinatoren håndterer tre andre forespørgsler. Udsendelse-til-ankomst tager yderligere 10–20 minutter, fordi teknikeren skal finde ud af hvilken maskine, slå manualen op og hente dele.

Selve reparationen? Ofte under 15 minutter.

Fabrikker der halverer responstiden gør typisk tre ting. For det første sender de alarmer direkte til den tildelte teknikers telefon med maskin-ID, fejlkode og placering. For det andet placerer de hyppigt brugte reservedele ved linjen i stedet for i et centralt lager. For det tredje vedhæfter de en kort fejlfindingscheckliste til hver alarmkode, så teknikeren ankommer med en plan.

Intet af dette kræver ny teknologi. Det kræver, at informationsflowet ændres, så den rigtige person får den rigtige kontekst med det samme. Et CMMS med mobile push-notifikationer klarer det meste. Flaskehalsen er næsten aldrig reparationskompetencen. Det er den tid, der bruges på at finde ud af, hvad der skete og hvor.

3. Udstyr der kører ud over de anbefalede driftscyklusser

OEM'er angiver servo-motorer til ca. 20.000 timer [3]. Fabrikker kører dem rutinemæssigt til 28.000 timer eller mere. Cyklustælling ligger i et regneark, hvis det overhovedet eksisterer. Når en servo fejler ved 26.000 timer, er det ikke en overraskelse. Det er en forudsigelig hændelse, som ingen fulgte op på.

Hver roterende komponent har en angiven levetid. Servo-motorer, spindellejer, kugleskruer, pneumatiske cylindre. OEM'er udgiver disse tal, men de ender i en mappe på en hylde.

Problemet er ikke, at fabrikker ignorerer vedligehold. Det er, at time- eller cyklusbaserede udskiftningsintervaller ikke er forbundet med maskinens faktiske driftstimer. En presse der kører to skift akkumulerer timer dobbelt så hurtigt som den samme presse på ét skift. Den kalenderbaserede PM-plan behandler dem ens.

Her er hvad der typisk sker. En servo-motor med en angivet levetid på 20.000 timer installeres. PM-planen siger "udskift hvert 3. år", hvilket forudsætter ét-skifts drift. Fabrikken tilføjer et ekstra skift seks måneder senere. Ingen opdaterer PM-intervallet. Motoren rammer 28.000 timer på 2,5 år og fejler.

Løsningen er at spore faktiske driftstimer pr. komponent, ikke pr. maskine. De fleste PLC'er tæller allerede cyklusser eller driftstimer internt. Dataene er der. De er bare ikke forbundet med vedligeholdelsessystemet.

Start med dine top 10 nedetidsbidragydere. For hver enkelt: find den angivne levetid for sliddelene. Sammenlign den med de faktiske akkumulerede timer. Du vil sandsynligvis finde flere komponenter, der kører 30–40 % ud over deres angivne levetid. Det er dine næste uplanlagte stop.

4. Spændingskvalitetsproblemer

Spændingsdyk under 90 % af nominel værdi får VFD'er til at trippe. De fleste fabrikker oplever 5–12 dykhændelser om måneden [4]. Linjen fejler, operatøren genstarter, og ingen logger grundårsagen. Uden overvågning af spændingskvalitet på tavleniveau ser disse hændelser ud som tilfældige stop.

Variable frequency drives er følsomme over for spændingskvaliteten på indgangen. Et spændingsdyk til 85 % af nominel i blot 100 millisekunder kan forårsage en DC-bus-underspændingsfejl. Drevet tripper, motoren stopper, linjen går ned.

Det frustrerende er, at disse hændelser er intermittente og svære at genskabe. Operatøren ser en drevfejl, nulstiller den, og linjen kører fint i timevis. Det ser tilfældigt ud. Men installerer man en spændingskvalitetsmåler på indføringen, finder man ofte et mønster.

Typiske årsager til spændingsdyk:

- Store motorer der starter på andre fødekredsløb i samme fabrik

- Forsyningsnetskoblinger (kondensatorbatterier, trinkobling)

- Svejseoperationer på delte kredsløb

- Kompressorstart uden soft startere

Fabrikker med 5–12 dykhændelser om måneden mister 30–90 minutters produktionstid pr. hændelse, når man inkluderer genstartsekvensen, kvalitetskontrol og genetablering af stabil drift.

Spændingskvalitetsmålere ved hovedtavlen koster 15.000–35.000 kr. installeret. De logger hvert dyk, overspænding og transient med tidsstempel. Når man har de data, kan man korrelere drevfejl med spændingshændelser. Løsningen kan være så simpel som at tilføje en DC-bus-reaktor til VFD'en, installere et ride-through-modul eller flytte et svejsekredsløb til en anden føder.

Uden data jager man spøgelser.

5. Råmaterialevariation

Indkommende materialeegenskaber som fugtindhold, viskositet og partikelstørrelse afviger mellem batcher og nogle gange inden for en batch. Hvis du ikke korrelerer materialebatchnumre med linjehastighed og kassationsrater, ser du ikke mønsteret. Linjen virker upålidelig, men den reelle variabel er råmaterialet.

En pakkelinje kører perfekt i tre dage og begynder så pludselig at blokere hvert 20. minut. Vedligeholdelsesteamet tjekker alt mekanisk. Intet er galt. Så skifter materialebatchen, og problemet forsvinder.

Dette mønster er almindeligt inden for fødevarer og drikkevarer, pharma, plast og enhver proces, hvor råmaterialeegenskaber har betydning. Filmtykkelse varierer med 5–10 mikron mellem ruller. Smeltindeks for harpiks skifter mellem leverandører. Pulverfugtindhold ændrer sig med lagerfugtigheden.

Linjen var tunet til en specifik materialespecifikation. Når materialet afviger, er linjeparametrene ikke længere optimale. Men fordi materialeændringen ikke spores sammen med maskinydelsen, forbinder ingen de to ting.

Hvad der hjælper:

- Log materialebatchnumre mod produktionskørsler i dit MES eller bare et fælles regneark.

- Spor indkommende materialecertifikater. Notér de faktiske værdier, ikke bare godkendt/afvist mod spec.

- Når du får en serie stop, tjek om materialebatchen er skiftet inden for de sidste 2–4 timer.

- Lav et simpelt scatterplot af kassationsrate mod centrale materialeegenskaber over 30 dage.

Du vil ofte opdage, at 80 % af dine "tilfældige" stop korrelerer med materialebatcher fra bestemte leverandører eller bestemte egenskabsintervaller. Det er handlingsrettet. Du kan stramme indgangskravene, justere linjeparametre pr. materialebatch eller sætte automatiske opskriftsskift op baseret på indgangstestresultater.

6. PLC- og softwarefejl

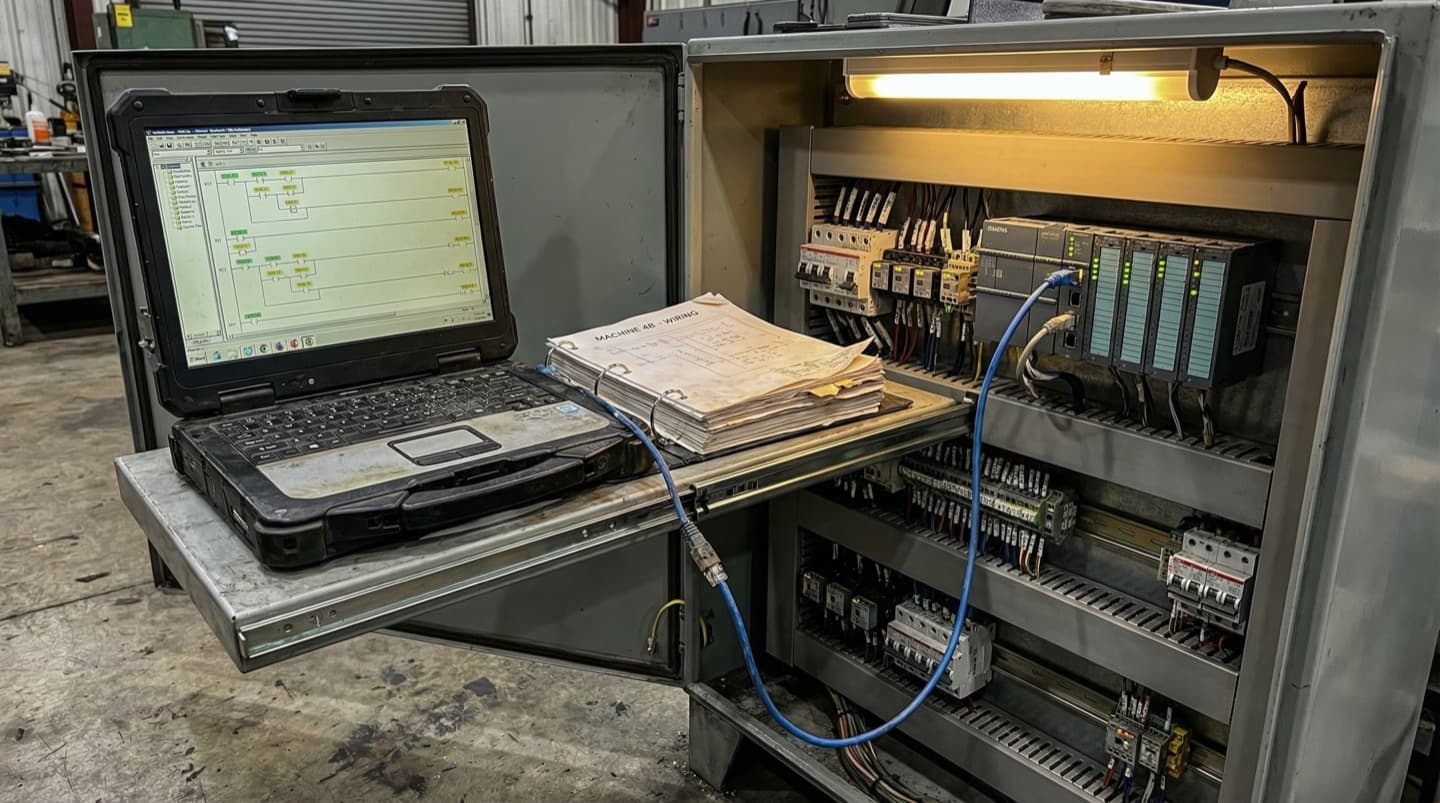

PLC-firmwareopdateringer, HMI-patches og opskriftsændringer introducerer fejl, der er svære at spore. Én forkert timerværdi, og linjen fejler for hver 200. cyklus. Softwareændringer er ikke altid versionsstyret eller dokumenteret. Maskinen kørte fint i går, fordi gårsdagens kode var anderledes.

En produktionslinje begynder at fejle intermittent. Alarmloggen viser en sekvenstimeout på station 4. Vedligehold tjekker de mekaniske komponenter. Alt ser fint ud. Den reelle årsag? Nogen justerede en timerværdi i PLC-programmet i tirsdags for at rette et andet problem, og det skabte en race condition, der kun udløses ved høje cyklushastigheder.

Dette sker oftere, end de fleste fabrikker vil indrømme. PLC-kode bliver ofte ændret af flere personer: OEM'ens integrator, fabrikkens automatiseringsingeniør, den eksterne underleverandør der tilføjede det nye visionssystem. Ændringer foretages online, nogle gange uden at gemme projektfilen. Der er ingen diff, ingen commit-log, ingen mulighed for at rulle tilbage.

Typiske softwarerelaterede stop:

- Timerværdier ændret for at løse ét problem, der skaber en fejl i en anden sekvens

- Opskriftsparametre uploadet fra en gammel backup, der ikke matcher det nuværende værktøj

- HMI-firmwareopdateringer der ændrer kommunikationsdriverens adfærd

- Ændringer i sikkerheds-PLC-logikken der ændrer genstartsekvensens timing

Løsningen er grundlæggende versionsstyringsdisciplin. Gem PLC-projektfilen efter hver ændring. Brug en navnekonvention med datoer. Endnu bedre: brug PLC-versionsstyringssoftware, der kan sammenligne ladder-logik og funktionsblokke.

Før enhver softwareændring sættes i drift: dokumentér hvad der blev ændret, hvorfor, og hvad trinene for tilbagerulning er. Når linjen begynder at fejle, bør det første spørgsmål være: har nogen rørt ved koden inden for de sidste 48 timer?

7. Operatørfejl ved vagtskifte

68 % af fabrikker rapporterer højere kassationsrater [5] i de første 30 minutter efter et vagtskifte. Afgående operatører videregiver ikke altid maskinens særheder, aktive alarmer eller parameterjusteringer, de har foretaget i løbet af deres vagt. Det nye hold starter koldt, og linjen betaler prisen.

Vagtoverdragelser er en kendt risiko. Dataene bekræfter det. Fabrikker der sporer kassation og nedetid pr. tidspunkt på dagen ser konsekvent stigninger i de første 30 minutter efter et vagtskifte. Mønsteret er forudsigeligt, men de fleste fabrikker behandler det som uundgåeligt.

Hvad der går galt ved overdragelser:

- Den afgående operatør justerede et temperatursetpunkt 2 grader op for at kompensere for en materialebatch. Det blev ikke nævnt. Den tilgående operatør ser det afvigende setpunkt og ændrer det tilbage.

- En maskine havde en intermittent fejl, som den afgående operatør lærte at omgå. Den tilgående operatør kender ikke løsningen og ringer til vedligehold.

- Den afgående operatør kørte de sidste 30 minutter af sin vagt med reduceret hastighed for at undgå et kendt blokeringspunkt. Den tilgående operatør starter med fuld hastighed.

Fabrikker der reducerer vagtskiftetab gør det med strukturerede overdragelsesprocedurer. Ikke et klippebord som ingen læser. Et 5-minutters stående møde ved maskinen med begge operatører til stede.

Overdragelsen bør dække tre ting: hvad er anderledes end standard lige nu, hvilke problemer opstod og hvordan blev de håndteret, og hvad er i kø til den næste vagt. Nogle fabrikker bruger en digital vagtlog, der vises på HMI'en. Andre bruger en whiteboard ved linjen. Formatet betyder mindre end vanen.

Én tilgang der fungerer godt: den tilgående operatør følger den afgående operatør i 10 minutter før det officielle vagtskifte. De kører maskinen sammen. Problemer der ville have taget 20 minutter at diagnosticere tager 2 minutter, fordi konteksten er lige ved hånden.

Hvad moderne teams gør anderledes

Fabrikker der skærer uplanlagt nedetid med 30 % eller mere har en fælles tilgang. De lægger rumlig kontekst oven på sensordata ved hjælp af digital twin-teknologi. I stedet for at overvåge individuelle datapunkter isoleret korrelerer de maskinstatus, miljøforhold og materialedata i en samlet visuel model.

Traditionel overvågning giver dig tidsseriegrafer på en skærm. Du ser, at motor 7 ramte 85°C klokken 14:14. Hvad du ikke ser, er, at motor 7 står ved siden af en damprørslækage, i et hjørne af fabrikken med begrænset luftstrøm, på en vagt der kørte 10 % over målhastigheden.

Digital twin-platforme løser dette ved at mappe sensordata på en rumlig model af produktionsgulvet. Hver sensor har en placering. Hver maskine har naboer. Hver miljøfaktor har en påvirkningszone.

Denne rumlige korrelation fanger mønstre, som flade dashboards overser. Når en VFD tripper, viser din digital twin dig, at tre andre VFD'er i samme eltavle har haft en stigende temperaturtendens i en uge. Et traditionelt alarmsystem behandler hvert drev uafhængigt.

Tilgangen virker, fordi produktionsproblemer sjældent er isolerede. Et stophændelse på én maskine er som regel det synlige symptom på et systemisk problem, der involverer samspillet mellem strøm, miljø, materiale og driftsparametre. At se de sammenhænge kræver en model, der bevarer de rumlige relationer.

Teams der bruger digital twins til grundårsagsanalyse rapporterer, at de finder den faktiske årsag til kroniske stop 40–60 % hurtigere end teams [6], der arbejder ud fra alarmlogger og regneark alene. Hastigheden kommer fra at kunne visuelt spore op- og nedstrømseffekter uden at gå fabriksgulvet igennem for hver undersøgelse.

Teknologien er modnet betydeligt de seneste år. Hvad der tidligere krævede måneders modellering og specialudvikling kan nu implementeres på dage ved hjælp af planteimport og automatisk sensormapping. Barrieren er ikke længere pris eller kompleksitet. Det er kendskabet til, at kategorien eksisterer.

FAQ

Ofte stillede spørgsmål

Relaterede ressourcer

Beregner for nedetidsomkostninger i produktion

Beregn de reelle omkostninger ved uplanlagt nedetid på dine produktionslinjer. Inkluderer tabt omsætning, lønspild og spildmaterialer. Gratis og med øjeblikkelige resultater.

Læs mereDigital twin vs SCADA

En praktisk sammenligning af SCADA og digital twin-platforme til produktion. Dækker datamodeller, visualisering, alarmer og implementering.

Læs mereDigital Twin vs MES

En praktisk sammenligning af MES og digital twin-platforme til produktion. Dækker ISA-95-niveauer, OEE-sporing, produktionssporing og hvordan de to systemer supplerer hinanden.

Læs mereForebyggelse af uplanlagt nedetid

De fleste producenter opdager nedetid, efter det har kostet dem. Sandhed giver jer synligheden til at fange udstyrsproblemer, før de lukker produktionen ned.

Læs mereVedligeholdelsesstyring

Vedligeholdelsesteams bruger timer på at finde serviceoptegnelser, jagte forsinkede opgaver og finde ud af, hvad der blev gjort sidst. Sandhed placerer hver arbejdsordre, serviceoptegnelse og vedligeholdelsesplan på jeres 3D-plantegning, hvor I kan se det.

Læs mereSådan reducerer du udstyrsnedetid: 8 strategier rangeret efter effekt

Nedetid falder ikke ved at gøre alt på én gang. De fabrikker der opnår de største reduktioner starter med deres nedetids-Pareto, retter den forebyggende vedligeholdelsesplan, tilføjer tilstandsovervågning på kritisk udstyr og kobler vedligeholdelsesdata til en rumlig model. Rækkefølgen er vigtigere end teknologivalget.

Læs mereSådan overvåger du en fabrikshal i realtid

Realtidsovervågning af en fabrikshal kræver mere end sensorer og dashboards. Du skal vælge de rigtige målepunkter, beslutte om data skal behandles på edge eller i cloud, designe alarmer der ikke giver træthed, og tænke miljøovervågning med fra starten. De fleste fabrikker starter med én produktionslinje og skalerer derfra.

Læs mereKilder

- Plant Engineering Magazine — 2023 Maintenance Survey: Root Causes of Unplanned Downtime

- Reliable Plant — Mean Time To Repair (MTTR) Explained

- General OEM Specifications — Servo Motor Rated Life Hours (Industry Standard)

- Electric Power Research Institute (EPRI) — Power Quality Survey: Voltage Sag Frequency in Industrial Facilities

- IndustryWeek / Plant Engineering — Shift Handover Impact on Quality and Scrap Rates

- McKinsey & Company — Digital Twins in Manufacturing: Accelerating Root Cause Analysis

- Aberdeen Group — The Cost of Downtime in Automotive Manufacturing

Stop med at gætte, hvorfor dine linjer går ned

Se hvordan rumlig sensorkorrelation finder de grundårsager, som alarmlogger overser. Få en gennemgang med dine egne plantegningsdata.